Microsoft beschuldigt tiental van maken tools om guardrails 'AI' te omzeilen

Microsoft heeft tien mensen beschuldigd van het ontwikkelen van tooling waarmee de 'guardrails' van OpenAI-diensten werden omzeild, en het mogelijk was om onder andere via DALL-E 'schadelijke afbeeldingen' te genereren. Guardrails zijn beveiligingsmaatregelen die onbedoeld gebruik van 'AI-diensten' moeten voorkomen.

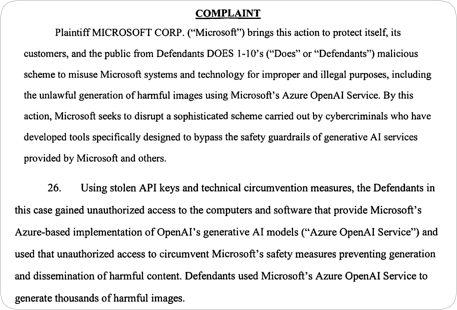

Volgens Microsoft hebben de tien niet bij naam genoemde verdachten gestolen inloggegevens en zelfontwikkelde software gebruikt om in te breken op systemen waarop Microsoft Azure OpenAI-dienst draait. Vervolgens zouden er duizenden 'schadelijke afbeeldingen' zijn gegenereerd waarmee de gebruiksvoorwaarden werden overtreden, aldus het techbedrijf. Om wat voor afbeeldingen het gaat laat Microsoft niet weten.

Microsoft stelt dat de verdachten inloggegevens van publieke websites scrapeten, waarmee ze toegang kregen tot accounts van betalende klanten. Het ging dan voornamelijk om gestolen Azure API keys en andere 'authenticatie-informatie'. Vervolgens werden de gecompromitteerde accounts en zelfontwikkelde software gebruikt om de werking van Microsofts 'AI-diensten' aan te passen.

Deze aangepaste diensten werden daarna aan andere malafide actoren aangeboden, met instructies hoe ze de zelfgemaakte tools konden gebruiken voor het genereren van 'schadelijke en illegale content' via diensten zoals DALL-E. Microsoft heeft de toegang van de verdachten inmiddels geblokkeerd en van de rechter toestemming gekregen om een door de verdachten gebruikt domein in beslag te nemen.

BTW, AI is leuk, maar controleren van de output blijft noodzakelijk want soms staan er totale onwaarheden in de output stream.

https://www.youtube.com/watch?v=XyiTDbKndNM

Volgens AI is het sentiment neutraal en de phrase count: 1.

BTW, AI is leuk, maar controleren van de output blijft noodzakelijk want soms staan er totale onwaarheden in de output stream.

Dat is net zoiets als de detectieve boeken in de bibliotheek afschermen.

Zo krijgt men een AI die zich gedraagt alsof we een kleuter zijn.

Deze posting is gelocked. Reageren is niet meer mogelijk.